El promedio: el placebo cognitivo más costoso

En el escrito anterior “Pensando en serio” escribí sobre lo perezoso que es el cerebro y como los atajos mentales surgen evolutivamente como mecanismo de eficiencia energética. En esta ocasión vale la pena desnudar un peligroso atajo que es el de los promedios. Son peligrosos porque son de una simpleza y una potencia tan fuerte que suavizan la realidad hasta volverla irrelevante. El promedio es un placebo cognitivo, creemos que entendemos algo, cuando en realidad sólo entendemos su sombra.

El promedio no mata por mentira, sino por omisión

Todos hemos oído el cuento del río que en promedio tiene un metro de profundidad. Sin embargo, cuando lo cruzamos nos ahogamos. Este cuento es muy útil para entender que el promedio nos mató, sencillamente porque nos negó el acceso a la información más valiosa: la variabilidad, los extremos, las excepciones. Y el cerebro, flojo por naturaleza, se enamora del promedio porque le ahorra pensar.

Vamos con dos ejemplos que muestran su cruel fatalidad.

#1: El apagón no lo causó El Niño: lo causó el adulto que creyó en el promedio

El apagón de 1992 no fue un episodio aislado, fue el reflejo de un país que durante años planificó con fórmulas promedio en un entorno de extremos. Fue el año de la hora Gaviria, el del programa radial “La Luciérnaga”, el año de las duchas frías, y el mejor año de la historia para ser un fabricante de velas.

Durante los años 80, los ingenieros del sistema interconectado (ISA, en ese entonces) calculaban la capacidad del país para generar energía con base en los promedios históricos de lluvia y de caudal en los ríos que alimentaban los embalses. Según esos datos, el sistema tenía reservas hídricas suficientes para abastecer al país incluso en épocas secas*. El promedio decía que el agua siempre volvería a caer. Los técnicos y los políticos creyeron que la historia climática era estable, que los promedios del pasado predecían el futuro. En 1992 llegó un fenómeno El Niño particularmente severo, las lluvias desaparecieron, los ríos se agotaron y los embalses que en teoría tenían “reserva promedio de 70 %” bajaron a menos del 15 %. Y como la inversión en térmicas era mínima (porque los promedios decían que no se necesitaban tanto), el país no tenía plan B. El modelo promediaba décadas de lluvias, pero no contemplaba la anomalía. El apagón duró más de 11 meses, el PIB se contrajo un 2.5%, miles de empresas quebraron y la popularidad del presidente César Gaviria se desplomó.

El sistema eléctrico colapsó no por falta de capacidad instalada, sino por exceso de confianza en promedios que ignoraban los extremos.

De ese apagón nació, años después, la idea del Cargo por Confiabilidad, un mecanismo que remunera a los generadores por mantener una capacidad disponible en momentos críticos, más allá de la producción promedio en condiciones normales. Es un seguro energético contra la arrogancia del promedio. Y no aprendemos, por eso sorprende que tres décadas después, el actual ministro proponga eliminar ese cargo, por hacer populismo tarifario nos pueden terminar quitando el escudo protector contra el dañino promedio.

(*): muy recomendable el escrito “1992: el año en que se nos fueron las luces”, allí claramente se dice que “Nadie podría prever el racionamiento en un país del que se había afirmado que estaba sobredimensionado en materia de energía” https://revistas.ucp.edu.co/index.php/gestionyregion/article/view/112/103

#2: El ahorrador juicioso: aplastado por un promedio

Imaginemos a John, un empleado público americano promedio de Illinois, una persona que en el año 2000 estaba a pocos años de retirarse. John nació a finales de la década de los 30, creció en la era de la escasez, nacido justo antes de la Segunda Guerra Mundial, con una infancia marcada por el racionamiento y la austeridad. Ahorró de manera juiciosa porque la supervivencia así se lo exigió y creció en un mundo sin crédito fácil, sin tarjetas, sin inflación “controlada”. Aprendió que el dinero se gana con esfuerzo y se guarda con miedo, John trabajó por más de 30 años como empleado público. Con mucho esfuerzo, a lo largo de sus años, John logró ahorrar US$ 500.000, planeando vivir otros 25 años de esos ahorros, retirando una módica suma anual de $ 40.000 durante ese periodo. Tomando como base el promedio de retorno anual del S&P 500 entre el inicio de 1950 y el cierre del año 1999, la no despreciable historia de 50 años, el dato arrojaba un promedio anual muy prometedor, un 10.5% anual de retorno*. John era muy conservador y averso al riesgo, y asumió que a futuro ese promedio se reduciría a 7-8%. Con esa información, en enero del 2000, John tomó la decisión de invertir los $ 500.000 en SPY, un ETF que existe desde 1993 y que replicaba muy bien al índice S&P 500 en general, con la idea de retirar los $ 40.000 al inicio de cada año para vivir de eso en el año correspondiente.

La historia es muy triste, todo iba bien hasta que en el año 2010 los ahorros de John se terminaron. Sólo alcanzó a disfrutar de poco más de 10 años, y John terminó luego vendiendo su casa, viviendo en refugios comunitarios, hasta que murió en la pandemia en una de las frías calles de Springfield. Los planes que había construido se los derrumbó un promedio.

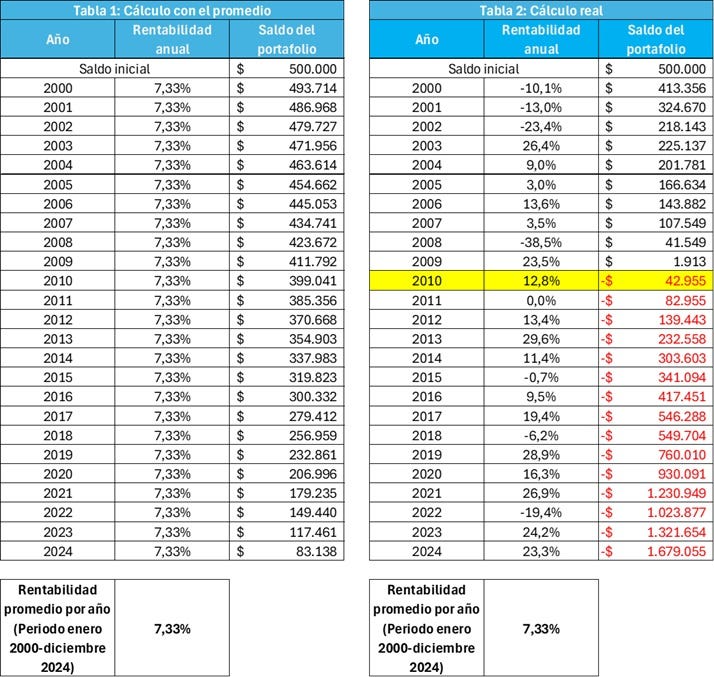

Miremos lo que ocurrió. En efecto, y con el privilegio de ver con ojos de historiador y no de profeta, el promedio del S&P 500 de los 25 años del plan de John (enero del 2000 – diciembre del 2024) estuvo cerca de lo que inicialmente John consideró. El promedio real del retorno del S&P 500 de esos 25 años fue de 7.33%, justo en el rango que John esperaba. Si el índice hubiese entregado religiosamente ese promedio año a año, John tendría un saldo positivo al finalizar el periodo de 25 años (ver tabla 1 abajo). Pero el índice es como el río, tiene partes más o menos profundas. La realidad del índice tiene variabilidad alta, y en el año 2010 el saldo se agotó (Tabla 2).

El error de John fue tomar una decisión tan importante basado en un promedio, sin entender que el retorno anual del S&P 500 en los 50 años que analizó (1950 a 1999) tenía una variabilidad altísima, con un dato máximo de 45.0% en 1954 y un dato terrible de -29.7% en 1974. Con un río con semejantes valles y montañas, creer en el promedio era garantía de ahogamiento. John no fue víctima de los mercados, sino de un número mal entendido.

El promedio es el lugar donde se esconden todas las tragedias individuales.

(*) https://www.macrotrends.net/datasets/2526/sp-500-historical-annual-returns

El origen del promedio: la necesidad humana de domesticar la incertidumbre

A finales del siglo XVIII, la humanidad estaba obsesionada con medirlo todo, el tiempo, el peso, la posición de los planetas. Era la era del cálculo, y los errores eran un problema casi filosófico: ¿cómo saber si algo era “verdad” cuando cada medición arrojaba un número distinto? Fue ahí donde apareció Pierre-Simon Laplace, un matemático y astrónomo francés con una obsesión: el azar debía tener leyes.

En 1774 propuso que, si se tomaban muchas observaciones de un fenómeno, los errores pequeños serían más comunes que los grandes, y tenderían a agruparse en torno a un valor central. Años más tarde, Carl Friedrich Gauss, un joven prodigio alemán, retomó las ideas de Laplace pero con una precisión quirúrgica. Gauss observó que los errores pequeños eran mucho más comunes que los grandes y que los errores positivos y negativos se compensaban entre sí, y que, al hacer muchas observaciones, todas se agrupaban en torno a un valor central. Entonces demostró que la forma matemática más probable que describía esos errores era una campana simétrica, donde el centro representaba el valor verdadero (o promedio) y que los lados mostraban qué tan probable era equivocarse mucho.

Ese fue su gran hallazgo, la ley del error, hoy llamada distribución normal o campana de Gauss.

La potencia de la campana de Gauss reside en su espíritu profundamente humano, nos sirve para domesticar la incertidumbre. Y la campana de Gauss refleja muy bien algunos fenómenos físicos, biológicos y sociales. Sin embargo, sólo en condiciones muy especiales podemos asumir una Campana de Gauss, y esas condiciones se deben dar de manera simultánea:

Cuando los eventos son independientes: uno no afecta al otro, no hay contagio, no hay efecto de red.

Cuando los eventos son simétricos: los errores positivos y negativos se compensan; no hay sesgo ni poder concentrado.

Cuando los eventos no se multiplican: sus efectos se suman linealmente, no crecen exponencialmente.

Cuando el entorno es estable: donde las reglas del juego no cambian (ausencia de crisis, innovación, guerra, salto tecnológico).

Cuando no hay de límites duros: las variables deben poder fluctuar hacia ambos lados sin topar límites físicos o lógicos (si existen límites, la distribución se trunca o se sesga).

La Campana de Gauss sólo describe el mundo cuando el azar es limpio, el entorno estable y las causas se suman sin dominantes. Es decir, necesitamos una realidad de laboratorio (limpia, esterilizada, calibrada y determinista) para aplicar la técnica Gaussiana. La realidad es bien diferente, es sucia, sudorosa y emergente. Los mercados financieros, la innovación tecnológica, la política, y las redes sociales viven fuera de la campana. Ahí gobiernan las colas gruesas: sucesos raros, impredecibles y desproporcionados.

El promedio fue inventado para medir estrellas, no personas y sus acciones. Y, sin embargo, lo usamos para explicar economías, políticas y vidas enteras. El problema no es que la campana de Gauss sea falsa, sino que la hemos convertido en refugio de los que temen al caos.

Leyes por fuera del promedio: Escuela del desorden estructurado

Para tratar de explicar una realidad sin edulcorantes, hay muchas aproximaciones estadísticas que usamos a diario. Todas ellas asumen un mundo asimétrico, no lineal, inestable y complejo.

La más conocida es tal vez la Ley de Pareto o el principio 80/20. A finales del siglo XIX, el economista italiano Vilfredo Pareto notó algo extraño al estudiar la distribución de la riqueza en Europa: el 80% de las tierras pertenecían al 20% de las familias. Este principio aplica muy bien en las ventas de las empresas (80% de las ventas en 20% de los clientes), al rendimiento de un portafolio de inversión (80% de los rendimientos en 20% de las posiciones), en software (20% del código causa el 80% de los errores), en salud ( 20% de los pacientes consume el 80% del gasto sanitario), entre varios otros.

Está también la Ley de Price, también conocida como la versión humana del Pareto. La Ley de Price, formulada por el físico y biólogo Derek J. de Solla Price en los años 60, dice algo tan simple como devastador: “El 50% del resultado total en un sistema proviene de la raíz cuadrada de sus participantes.” Si en una organización hay 100 empleados, la Ley de Price dice que 10 de ellos generan la mitad de todo el valor. Si hay 10.000 científicos publicando, 100 producen la mitad de los papers. Esto trae una consecuencia fundamental en la cultura organizacional de las empresas: el éxito no se reparte en forma de campana, sino de avalancha. La Ley de Price explica en gran parte la disparidad de salarios en las compañías.

La Ley de Zipf muestra el orden oculto detrás del caos aparente. En 1935, el lingüista estadounidense George Kingsley Zipf empezó a contar palabras. Analizó textos enteros en inglés y descubrió algo sorprendente: las palabras no se usan de forma aleatoria, sino siguiendo una proporción matemática casi perfecta. Si ordenamos todas las palabras de un idioma por su frecuencia de uso encontramos que la palabra más usada (“the”, en inglés) aparece el doble de veces que la segunda (“of”), y tres veces más que la tercera (“and”), y cuatro veces más que la cuarta (“to”). Zipf descubrió un patrón que no sólo aplicaba a las palabras, sino a casi todo lo que los humanos organizan espontáneamente. En un país, la segunda ciudad más grande suele tener la mitad de la población de la primera. La tercera tiene la tercera parte, y así sucesivamente. En Internet, el segundo sitio más visitado tiene la mitad del tráfico del primero. En economía, la segunda empresa del sector factura la mitad de la primera.

Y hay muchas otras, Ley de potencias ( Mandelbrot), Ley de la complejidad (Morin, Prigogine), Ley de los cisnes negros (Taleb), Ley de la información (Shannon).

A diferencia de Gauss, estas leyes aceptan un mundo más caótico e imperfecto, y de allí su valor para explicar muchas realidades. Pero al igual que Gauss, todos los demás han tratado de hacer lo mismo: entender lo que nos supera. Y que bien que lo han hecho todos, nos van moldeando la geometría del misterio, y con cada aproximación y cada ley, vamos entendiendo que hay patrones que insinúan sentido.

De nuevo un escrito muy acertado, instructivo y entretenido! Gracias

Muy bueno Mr Nico! La siguiente debería ser sobre la Teoría del Caos… sistemas de ecuaciones no lineales para explicar el efecto mariposa!!! Gracias por estos insights